ביום שני, אפל שיתפה את תוכניותיה לאפשר למשתמשים להצטרף למכשירמודיעין של אפלאימונים בטכניקות פרטיות דיפרנציאליות הדומות להפליא למערכת הגילוי שלה CSAM.

פרטיות דיפרנציאלית היא מושג שאפל חיבוק בגלויבשנת 2016עם iOS 10. זה אשיטת שרת פרטיותשל איסוף נתונים המציג רעש לדגום נתונים כדי למנוע מאספני הנתונים להבין מאיפה הנתונים הגיעו.

לְפִיפוסטבבלוג למידת המכונה של אפל, אפל פועלת ליישום פרטיות דיפרנציאלית כשיטה לאיסוף נתוני משתמשים להכשרת Apple Intelligence. הנתונים מסופקים על בסיס הצטרפות, באופן אנונימי, ובאופן שלא ניתן לייחס אותו למשתמש בודד.

הסיפור היהמכוסה לראשונהעַל יְדֵיבלומברגשהסביר את הדוח של אפל על שימוש בנתונים סינתטיים שהוכשרו על מידע על משתמשים בעולם האמיתי. עם זאת, זה לא פשוט כמו לתפוס נתוני משתמשיםאייפוןלנתח בחוות שרתים.

במקום זאת, אפל תשתמש בטכניקה הנקראת פרטיות דיפרנציאלית, שאם שכחתם, היא מערכת שנועדהלהציג רעשלאיסוף נתונים כך שלא ניתן לאתר נקודות נתונים בודדות למקור. אפל לוקחת את זה צעד אחד קדימה על ידי השארת נתוני משתמשים במכשיר - רק סקר לדיוק והורידה את תוצאות הסקר ממכשיר המשתמש.

שיטות אלה מבטיחות כי העקרונות של אפל מאחורי פרטיות וביטחון נשמרים. משתמשים שבחרו בשיתוף ניתוח מכשירים ישתתפו במערכת זו, אך אף אחד מהנתונים שלהם לא יעזוב את ה- iPhone שלהם לעולם.

ניתוח נתונים ללא מזהים

פרטיות דיפרנציאלית היא מושג שאפל נשענה ופיתחה מאז לפחות 2006, אך לא עשתה חלק מזהותו הציבורית עד 2016.זה התחילכדרך ללמוד כיצד אנשים השתמשו באמוג'ים, כדי למצוא מילים חדשות למילונים מקומיים, להפעיל קישורים עמוקים בתוך אפליקציות וככלי חיפוש הערות.

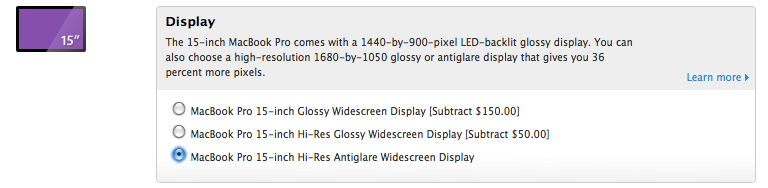

ניתוח נתונים עם פרטיות דיפרנציאלית. מקור תמונה: אפל

אפל אומרת שהתחלה עםiOS 18.5, פרטיות דיפרנציאלית תשמש לניתוח נתוני משתמשים ולהכשיר מערכות מודיעין ספציפיות של אפל החל מגנמוג'י. זה יוכל לזהות דפוסים של הנחיות נפוצות שאנשים משתמשים בהם כדי שאפל תוכל טוב יותר לאמן את ה- AI ולקבל תוצאות טובות יותר עבור הנחיות אלה.

בעיקרון, אפל מספקת הנחיות מלאכותיות שלדעתם פופולריות, כמו "דינוזאור בכובע קאובוי" והיא מחפשת התאמות דפוסים בניתוח נתוני משתמשים. בגלל רעש שהוזרק באופן מלאכותי וסף של צורך במאות התאמות שברים, אין דרך לעלות על הנחיות ייחודיות או זיהוי אינדיבידואלי.

בנוסף, אלה מחפשים שברים של הנחיות רק גורמים לסקר חיובי או שלילי, כך שאף נתוני משתמשים אינם נגזרים מהניתוח. שוב, לא ניתן לבודד נתונים ולעקוב אחר אדם או מזהה יחיד.

אותה טכניקה תשמש לניתוח מגרש משחקים של תמונות, שרביט תמונות, יצירת זיכרונות וכלי כתיבה. מערכות אלה מסתמכות על הנחיות קצרות, כך שניתן יהיה להגביל את הניתוח להתאמת תבניות פקודה פשוטות.

אפל רוצה לקחת שיטות אלה עוד יותר על ידי יישוםן לייצור טקסטים. מכיוון שייצור טקסטים לדוא"ל ומערכות אחרות מביא להנחיות ארוכות בהרבה, וכנראה, נתוני משתמשים פרטיים יותר, אפל נקטה צעדים נוספים.

אפל משתמשתמחקר אחרוןלפיתוח נתונים סינתטיים שניתן להשתמש בהם כדי לייצג מגמות מצטברות בנתוני משתמשים אמיתיים. כמובן שזה נעשה מבלי להסיר מעט טקסט ממכשיר המשתמש.

לאחר יצירת דוא"ל סינטטי שעשוי לייצג דוא"ל אמיתי, הם משווים לדגימות מוגבלות של דוא"ל משתמש אחרונים שחושבו להטמעים סינתטיים. ההטמעות הסינתטיות הקרובות ביותר לדגימות במכשירים רבים מוכיחים אילו נתונים סינתטיים שנוצרו על ידי אפל מייצגים את התקשורת האנושית האמיתית ביותר.

ברגע שנמצא דפוס על פני מכשירים, ניתן לעודד נתונים סינתטיים והתאמת דפוס כדי לעבוד על פני נושאים שונים. התהליך מאפשר לאפל להכשיר מודיעין של אפל לייצר סיכומים והצעות טובות יותר.

שוב, שיטת הפרטיות הדיפרנציאלית של אימוני מודיעין של אפל היא הצטרפות ומתקיימת במכשיר. נתוני משתמשים לעולם לא עוזבים את המכשיר, ותוצאות הסקרים שנאספו הוצגו רעש, כך שאפילו נתוני משתמשים אינם קיימים, לא ניתן לקשור תוצאות אינדיבידואליות למזהה יחיד.

שיטות אימון מודיעין של אפל נשמעות מוכרות מאוד

אם השיטות של אפל כאן מצלצלות בפעמונים, זה בגלל שהם נראים דומים לשיטות החברהמתוכנן ליישם, אך נטוש, לגילוי CSAM. המערכת הייתה ממירה תמונות משתמשים לחיפוש שהושוו למסד נתונים של חשיש של CSAM ידוע.

תכונת זיהוי CSAM של אפל הסתמכה על תמונות חסידות מבלי להפר את הפרטיות או השבירת הצפנה

עם זאת, מדובר בשתי מערכות שונות מאוד עם יעדים שונים. מערכת ההדרכה המודיעית החדשה של אפל נבנית כדי למנוע מאפל ללמוד כל דבר על המשתמש, ואילו גילוי CSAM עלול להוביל לכך שאפל לגלות משהו על תמונות של משתמש.

ניתוח זה יתרחש בiCloudאחסון תמונות. אפל הייתה יכולה לבצע את התאמת ה- Hash של התמונות בשיטה בשם Private Set Intersection, המתבצעת מבלי להסתכל על צילום משתמש או הסרת תמונה מ- iCloud.

כאשר מספיק מקרים של תוצאות חיוביות פוטנציאליות עבור התאמות של חשיש CSAM התרחשו במכשיר יחיד, היא הייתה מפעילה מערכת ששלחה תמונות מושפעות לנתח על ידי בני אדם. אם התמונות שהתגלו היו CSAM, הרשויות קיבלו הודעה.

מערכת גילוי CSAMפרטיות המשתמש שמורה, הצפנת נתונים, ועוד, אך היא גם הציגה וקטורי התקפה חדשים ופוטנציאליים שעשויים להיות מנוצלים על ידי ממשלות סמכותיות. לדוגמה, אם ניתן להשתמש במערכת כזו כדי למצוא CSAM, אנשים מודאגים ממשלות יכולות להכריח את אפל להשתמש בה כדי למצוא סוגים מסוימים של דיבור או תמונות.

תַפּוּחַבסופו של דבר ננטשמערכת גילוי CSAM. לתפקיד ישמדבריםכנגד ההחלטה של אפל, מציעה שהחברה לא עושה דבר כדי למנוע התפשטות של תוכן כזה.

שימו לב, בעוד שלתכונת גילוי CSAM יש מספר הקבלות למערכת ההדרכה החדשה של Apple Intelling, הם בנויים על טכנולוגיות שונות. הרעש שהוצג בפני מערכי הנתונים לנתוני משתמשים מעוררים, וזה מה שהופך אותו לפרטיות דיפרנציאלית, לא היה חלק מתכונת הגילוי של CSAM, למשל.

מכיוון ששתי המערכות כוללות המרת נתוני משתמשים לחסימת נתונים דומה, זה יכול להיות קל לראות קווי דמיון בין השניים. עם זאת, לטכנולוגיות יש יסודות ומטרות שונות מאוד.

ביטול הסכמת אימוני מודיעין של אפל

בעוד שחלקים מהיישום נראים דומים, נראה כי אפל נחתה בשימוש הרבה פחות במחלוקת. אף על פי כן, יש כאלה שיעדיפו לא להציע נתונים, פרטיות מוגנת או לא, להכשיר מודיעין של אפל.

להצטרף או החוצה באמצעות הגדרות ניתוח הנתונים

שום דבר לא יושם עדיין, אז אל תדאג, עדיין יש זמן להבטיח שאתה מבטל את הסכמתך. אפל אומרת שהיא תציג את התכונה ב- iOS 18.5 והבדיקה תחל ב-בטא עתידיו

כדי לבדוק אם אתה מתמודד או לא, פתח הגדרות, גלול מטה ובחרפרטיות ואבטחהואז לבחורניתוחים ושיפוריםו החלף את ההגדרה "שתף את האייפון ושעון אנליטיקס" כדי לבטל את ההדרכה של AI אם עדיין לא עשית זאת.